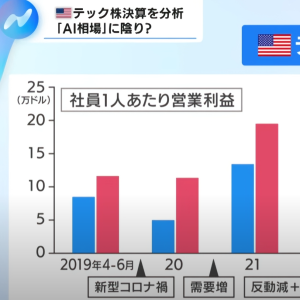

4. AI導入の社会的・倫理的側面:監獄/政府/インフラでの事例から考える

目次

🔍 1. 英国の刑務所における「未来犯罪予測AI」

英国司法省は、囚人の暴力行為を予測するAIツールを刑務所システムに導入しました。年齢・薬物使用歴・過去の暴力事件といったデータを学習し、リスクの高い受刑者を識別して事前介入を行います(Cybernews)。

このシステムにより、職員に対する暴行を未然に防ぐとも言われています。しかし、過去の犯罪記録に基づく予測は、少数民族や低所得層への偏見や誤判リスクを伴い、人権や公平性の観点から強い批判もあります(ザ・ガーディアン, statewatch.org, ザ・タイムズ, ウィキペディア)。

🏛 2. インド・マハラシュトラ州のAIガバナンスと行政サービス

インド・マハラシュトラ州政府は、産業・労働・鉱業関連サービスを統合するe‑ガバナンス・プラットフォーム開発を承認。AI対応の多言語チャットボット(マラーティー語と英語対応)、GIS ベースの施設マッピング、リアルタイムダッシュボード付きで設計中です(The Times of India)。

また、AIを活用した農業政策として、AI農業プラットフォーム「MahaAgri-AI Policy」も承認。精密農業やリアルタイム作物アドバイス、気候予測などを通じて農業体験や経済支援に繋げる狙いがあります(Elets eGov)。

さらに、Nagpur ではVR・スマートダッシュボードを備えたAI駆動の幼児教育センター(Anganwadi)を開設し、教育の平等化を目指す取り組みも始まりました(IndiaAI)。

🚓 3. AIによる治安・法執行の未来:法律・倫理・プライバシーとの折り合い

マハラシュトラ州では、MARVEL(Maharashtra Advanced Research and Vigilance for Enhanced Law Enforcement)というAIシステムを警察の犯罪予測・捜査支援に導入。警察とIIM Nagpurらが共同で設立し、犯罪の早期発見と効率化を図る狙いです(ウィキペディア)。

政府はMicrosoftやIBMとの協力で、教育・行政・公共安全領域のAIセンター設立や政策立案(AIポリシー策定)も進めており、インフラから治安まで幅広くAI導入を模索中です(The Economic Times, APAC Media, CoinGeek, Elets eGov, ウィキペディア)。

⚠️ 4. 共通する倫理的課題と考察ポイント

| 視点 | 課題・懸念ポイント |

|---|---|

| 公正性 | 予測AIは統計的偏見を再生産し、特定集団を不利に扱う可能性あり(ウィキペディア, statewatch.org) |

| 透明性 | アルゴリズムの仕組みや評価指標、介入の判断根拠が公開されず、不透明な運用に警鐘(arxiv.org, statewatch.org) |

| プライバシー | 犯罪歴だけでなく健康・行動データも活用されるため、個人情報の扱いと同意が重要(ザ・ガーディアン, gov.uk) |

| ガバナンス | 民主的監視や第三者監査、不服申し立て制度の整備が不可欠 |

✅ 5. まとめと今後に向けて

こうしたAI導入事例は、安全性や効率化、生活の質向上を目指す一方で、公平性・プライバシー・説明可能性に関する深刻な倫理的問題を伴います。

今後は、

- アルゴリズムの透明性確保、

- 多様なステークホルダーによる監視、

- 法的保護と説明責任を持った制度設計

が求められます。AIを単に導入するだけでなく、人権尊重と社会的合意形成を前提とした運用こそが、持続可能な未来社会の鍵となるでしょう。